Un informante anónimo ha provisto pruebas de que Facebook no solo no actúa ante la proliferación de perfiles de simpatizantes de grupos terroristas, sino que los mismos algoritmos de la red social promueven de forma automática los ideales extremistas.

La evidencia fue recopilada entre agosto y diciembre de 2018 y recientemente publicada en un informe de 48 páginas por el Centro Nacional de Informantes estadounidense (NWC, por sus siglas en inglés), en el que se detalla que Facebook crea diversos tipos de contenido —entre ellos páginas de negocios y videos de celebración y memorias— para individuos ligados a grupos yihadistas.

El estudio mostró que de las 3.228 cuentas pertenecientes a simpatizantes de terroristas autoidentificados, solo el 30 % fue eliminado por la plataforma. Muchos de esos "amigos", registrados en varias partes del mundo, "abiertamente se identificaron a sí mismos como terroristas y compartieron contenido extremista", señala el resumen ejecutivo del reporte.

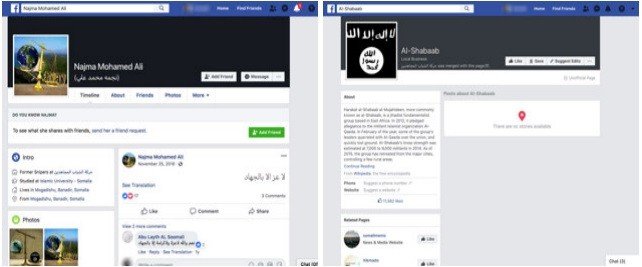

En cuanto al contenido autogenerado, el informe proporciona un ejemplo: algunos usuarios de Facebook presuntos integrantes del grupo somalí Al Shabaab —vinculado a Al Qaeda y recientemente al Estado Islámico—, incluyeron esa membresía en la parte de sus perfiles que especifica la ocupación laboral, por lo que la red social automáticamente creó para esa agrupación terrorista una página de "negocio local" que incluye el logotipo del Estado Islámico.

Otra de estas páginas fue creada para el grupo terrorista Hayat Tahrir al Sham (Frente Al Nusra) a partir de los 'me gusta' de 63 perfiles, 31 de los cuales corresponden a terroristas reales que viven en la provincia siria de Idlib, según determinó una ONG local.

El reporte añade que el gigante de las redes sociales facilita la glorificación del terrorismo, y expone como ejemplo el caso de un usuario que recibió más de 2.000 'me gusta' por sus frecuentes y sangrientas publicaciones de violencia y muerte relacionadas con el terrorismo. Facebook destacó esa cantidad de interacciones como un "logro", y generó un 'post' de celebración que luego fue compartido en el perfil.

El estudio apunta a que la compañía aprobó de forma consciente al menos parte de estos apoyos al extremismo, pues la opción que permite jurar lealtad a un equipo deportivo o expresar apoyo a un país, una de las características que —según el reporte— fueron utilizadas para manifestar simpatía al terrorismo, requiere de la aprobación previa de un moderador de Facebook antes de su uso público.

El NWC ha presentado una petición ante la Comisión de Bolsa y Valores de EE.UU. para que "sancione a Facebook por su deshonestidad sobre el terror y el contenido de odio en su sitio web". La compañía de Mark Zuckerberg, por su parte, había afirmado el año pasado que elimina eficazmente el 99 % del contenido de Al Qaeda y el Estado Islámico antes de ser publicado, aunque aclaró que no puede detectar todo este tipo de publicaciones.

Si te ha gustado, ¡compártelo con tus amigos!